# Deepfake : une technologie de trucage vidéo inquiétante

**Date:** 6 juin 2026

**Source:** [PIX GEEKS](https://pix-geeks.com)

**Catégories:** [High-Tech](https://pix-geeks.com/tech/) > [Intelligence Artificielle](https://pix-geeks.com/tech/intelligence-artificielle/)

**Étiquettes:** [Effets spéciaux](https://pix-geeks.com/dossier/effets-speciaux/), [Fake](https://pix-geeks.com/dossier/fake/)

**Tout le monde connait les fakes news, ces informations complètement fausses. Elles risquent de prendre de plus en plus d’ampleur avec l’émergence des deepfakes, des vidéos truquées qui permettent de faire dire n’importe quoi à n’importe qui. Explications.**

## Mark Zuckerberg victime d’une vidéo Deepfake

> J’aimerais pouvoir vous dire que notre mission est de connecter les gens entre eux, mais ce n’est pas le cas. Nous voulons simplement contrôler vos comportements futurs. Plus vous vous exprimez, plus nous vous possédons.

Ces propos exprimés dans la vidéo ci-dessous par Mark Zuckerberg sont évidemment complètement faux, et sont issus d’un deepfake :

[Post Instagram](https://www.instagram.com/p/BypkGIvFfGZ/)

## Définition du DeepFake

Le mot deepfake est un mot valise faisant référence au **Deep Learning** (un type d’IA basée sur l’apprentissage) et aux **Fake News**, pour des raisons évidentes.

Le principe du **deepfake** est aussi simple que terrifiant : il consiste à remplacer sur une vidéo le visage d’une personne par celui d’une autre, et permet aussi par extension de modifier les mouvements de sa bouche afin de lui faire dire exactement ce que l’on souhaite.

On peut donc avec cette techno faire **dire des choses à des personnalités connues** pour s’amuser (comme [ici avec Jon Snow](https://pix-geeks.com/game-of-thrones-jon-snow-sexcuse-saison-8-video-delirante/)) ou bien pour **manipuler l’opinion publique.**

Quand cette technologie est utilisée avec le visage de personnalités, des imitateurs peuvent produire la partie sonore du nouveau discours ou on peut utiliser des outils de synthèse vocale.

## Fabriquer une vidéo Deepfake est d’une facilité déconcertante

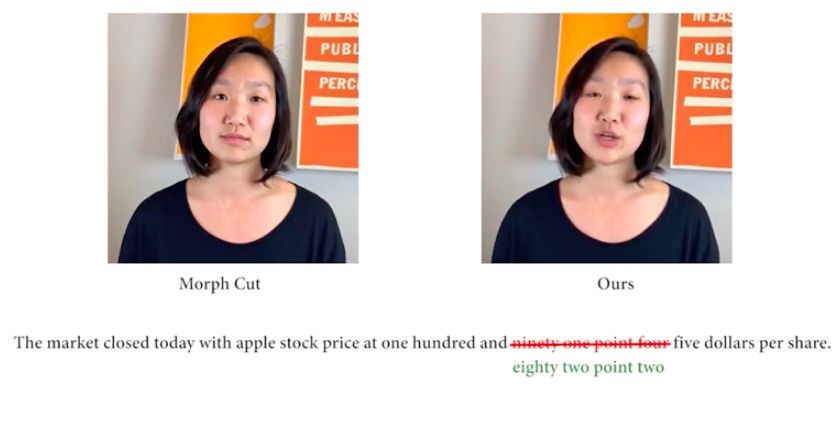

Des chercheurs des universités de Stanford et Princeton, d’Adobe Research et de la Max Planck Institute for Informatics ont récemment mis au point un système qui permet de générer une vidéo deepfake afin de modifier ce que dit une personne … à l’aide d’un simple fichier texte.

Ils ont expliqué dans un [communiqué](https://www.ohadf.com/projects/text-based-editing/) leur méthode.

En synthèse :

- les phonèmes sont détachés de la vidéo originelle

- et **un modèle 3D est créé sur le bas du visage pour pouvoir ajouter les expressions faciales souhaitées**

Cette opération permet de **supprimer des mots dans une phrase, d’en ajouter et de les modifier** pour un résultat absolument terrifiant :

[" rel="nofollow">!\[YouTube video thumbnail\](https://pix-geeks.com/wp-content/uwkmsq-1894/pxnetwork-frontoffice-wp-youtube-lyte/lyteCache.php?origThumbUrl=https%3A%2F%2Fi.ytimg.com%2Fvi%2F0ybLCfVeFL4%2F0.jpg)

Lire cette vidéo sur YouTube]([Vidéo YouTube](https://youtu.be/0ybLCfVeFL4))

## Les stars, premières cibles des deepfakes sur Instagram et YouTube

Mark Zuckerberg n’est évidemment pas le premier a être ciblé par ce type de vidéo truquée.

Kim Kardashian, [" target="_blank">Barack Obama](%3Ciframe%20loading=), ou encore Morgan Freeman ont fait l’objet de montages. Plusieurs vidéos de ce type peuvent être consultées sur le compte Instagram de [@bill_posters_uk](https://www.instagram.com/bill_posters_uk/).

Le commentaire de fetishiasian ci-dessus en est le parfait exemple :

> Attendez, est-ce que c’est censé être faux ou vrai ?

> Je ne sais pas du tout

## Les Fake News, fléau du XXIème siècle

Les Fake News ont déjà tendance à se propager plus vite que les vraies informations et à faire beaucoup de mal. Dans ce contexte, des vidéos aussi bien truquées ne vont faire qu’aggraver la désinformation dont nous sommes déjà tous victimes.

Les chercheurs derrière l’outil présenté ci-dessus ont ajouté :

> Nous reconnaissons que les mauvais acteurs pourraient utiliser de telles technologies pour falsifier des déclarations personnelles et calomnier des personnalités.

> Nous sommes préoccupés par une telle déception et une mauvaise utilisation.

On ne peut que leur donner raison, et il va falloir être de plus en plus vigilant en particulier au sujet de vidéos diffusées sur les réseaux sociaux…

[" rel="nofollow">!\[YouTube video thumbnail\](https://pix-geeks.com/wp-content/uwkmsq-1894/pxnetwork-frontoffice-wp-youtube-lyte/lyteCache.php?origThumbUrl=https%3A%2F%2Fi.ytimg.com%2Fvi%2FbPhUhypV27w%2F0.jpg)

Lire cette vidéo sur YouTube]([Vidéo YouTube](https://youtu.be/bPhUhypV27w))

[Vidéo YouTube](https://www.youtube.com/watch?v=0ybLCfVeFL4)

[Vidéo YouTube](https://www.youtube.com/watch?v=cQ54GDm1eL0)

[Vidéo YouTube](https://www.youtube.com/watch?v=bPhUhypV27w)

---

**Article précédent:** [Amazon travaille sur un bracelet capable de décrypter vos émotions](https://pix-geeks.com/amazon-bracelet-decrypter-emotions/) | **Article suivant:** [Un robot maltraité se rebelle contre ses créateurs](https://pix-geeks.com/robot-maltraite-rebelle-contre-createurs/)